تتسارع وتيرة التطور التقني بشكل غير مسبوق، مما جعل لوائح الذكاء الاصطناعي تتصدر أجندة الحكومات والمؤسسات الدولية. ومع دخول الذكاء الاصطناعي في أد

تتسارع وتيرة التطور التقني بشكل غير مسبوق، مما جعل لوائح الذكاء الاصطناعي تتصدر أجندة الحكومات والمؤسسات الدولية. ومع دخول الذكاء الاصطناعي في أدق تفاصيل حياتنا اليومية، أصبح وجود إطار قانوني وتشريعي يحكم استخداماته ضرورة حتمية لضمان الأمان والخصوصية. فبينما يرى البعض في هذه التقنية فرصًا اقتصادية هائلة، تبرز تساؤلات ملحة حول أخلاقيات الذكاء الاصطناعي وكيفية صياغة قوانين توازن بين تشجيع الابتكار وحماية الإنسانية.

فلم يعد السؤال المطروح اليوم هو “ماذا يمكن للذكاء الاصطناعي أن يفعل؟” بل “هل يمكن التحكم بما يفعله؟”.

عرّاب التقنية يدعو لسن لوائح الذكاء الاصطناعي

وفي مقابلة مع هيئة الإذاعة البريطانية عبّر البروفيسور جيفري هينتون الملقب بـ “عراب الذكاء الاصطناعي” عن قلقه العميق من ما يحمله الذكاء الاصطناعي في المستقبل. وقال “يجعلني الأمر حزينًا جدًا لأنني قضيت حياتي في تطوير هذه التقنيات، وهي الآن خطيرة للغاية، والناس لا يأخذون هذه المخاطر على محمل الجد بما يكفي”.

وأضاف: “أعتقد أنه من الواضح أننا بحاجة إلى لوائح تنظيمية قوية للذكاء الاصطناعي. البشر تنافسيون للغاية؛ لقد تطورنا من عصابات صغيرة متحاربة من الشمبانزي، ونحن بحاجة لمنع إساءة استخدام الذكاء الاصطناعي عبر قوانين حكومية”.

وأشار إلى أنه من المؤسف أن “هذه التكنولوجيا القوية للغاية يتم تطويرها وإطلاقها في وقت يبدو أننا نتحرك فيه نحو حكومات سلطوية”.

كما أجاب هينتون على سؤال أعده الذكاء الاصطناعي بشأن الخطأ الذي لا يمكن الرجوع عنه والذي قد ترتكبه البشرية في السنوات الخمس القادمة، والقرار الملموس الذي من شأنه أن يقلل من خطر هذا الخطأ.

وقال جيفري هينتون، الحائز على جائزة نوبل في الفيزياء عن أعماله في مجال التعلم الآلي: ” أعتقد أن هناك العديد من الأخطاء، لكن أكبر خطأ هو عدم إجراء أبحاث كافية حول كيفية التعايش بسلام مع كائنات ذكية أكثر ذكاءً منا، رغم أننا نحن من صنعها. بما أننا نصنعها، فلا يزال لدينا خيارات، لكن يجب أن نكون حذرين جداً، لأننا إذا صنعناها بحيث لا تهتم بنا، فمن المرجح أنها ستمحو وجودنا”.

يرى هينتون أن الذكاء الاصطناعي سيصبح أذكى من البشر في غضون 10 سنوات فيما يتفق جميع الخبراء على حدوث ذلك خلال 20 عامًا.

ويوضح “أنه في كثير من المجالات، هي بالفعل أذكى منا بكثير. لذا، نحن لا نعرف كيف سيكون الأمر، ومن الملح جدًا إجراء أبحاث حول كيفية التعايش معها، بينما يُبذل حاليًا القليل جدًا من الجهد في هذا الصدد”.

وبحسب هينتون، سيكون الذكاء الاصطناعي أكثر إقناعًا أيضًا، ويقول: “إن فكرة أن نقوم بإيقافه ببساطة لن تنجح، لأنه سيكون قادرًا على إقناع الشخص المسؤول عن إيقافه بأن القيام بذلك فكرة سيئة جدًا.”

ويحذر من أن العالم سيشهد منافسة بين الولايات المتحدة والصين في مجالات كثيرة كالهجمات السيبرانية والأسلحة الفتاكة ذاتية التشغيل والتزييف العميق. لكنها سيتعاونان في مجال واحد وهو محاولة منع انظمة الذطاء الاصطناعي من السيطرة على البشر.

وقال: “في ذروة الحرب الباردة، تعاونت أميركا والاتحاد السوفيتي لمنع حرب نووية عالمية لأنها لم تكن في مصلحة أي منهما. مصالح الصين وأميركا تلتقي في عدم رغبة الذكاء الاصطناعي في الاستيلاء على السلطة”.

مخاطر الذكاء الاصطناعي

وبناءً على التوجهات البحثية الحديثة التي تناقشها الأوراق العلمية المنشورة في “ScienceDirect” لعام 2025، تتبلور مخاطر الذكاء الاصطناعي في إطار يجمع بين التهديدات التقنية والتبعات المجتمعية العميقة؛ حيث تبرز المخاطر المجتمعية والانتهاكات الحقوقية والقانونية كأولوية قصوى نتيجة قدرة هذه الأنظمة على تضخيم الانحيازات الممنهجة والتمييز الرقمي. وتؤكد الدراسات أن اتساع الفجوة بين سرعة التطور التقني وبطء الأطر التنظيمية يضاعف من المخاطر الإدراكية المرتبطة بالتضليل الإعلامي و”التزييف العميق”، مما يهدد الثقة العامة والعمليات الديمقراطية.

علاوة على ذلك، تبرز المخاطر الوجودية والبيئية، حيث يستهلك تطوير النماذج الضخمة موارد طاقة هائلة، بينما تظل معضلة “الجانب المظلم” للذكاء الاصطناعي متمثلة في احتمالية فقدان السيطرة البشرية على الأنظمة ذاتية التشغيل، خاصة في المجالات الحساسة مثل الرعاية الصحية والأمن القومي، مما يجعل حوكمة هذه التقنيات ضرورة وجودية لا مجرد خيار تنظيمي.

وفيما يتعلق بفقدان خصوصية البيانات، ثمة خطران رئيسيان. الأول يتعلق بالبيانات نفسها: فبمجرد جمعها، قد تُعرّض خصوصية الأفراد الذين تتضمن بياناتهم للخطر. أما الخطر الثاني فينشأ بعد تقييم نماذج الذكاء الاصطناعي. ففي بعض الحالات، يُمكن استعادة بيانات الأفراد من التنبؤات التي وضعتها النماذج المُقَدَّرة مسبقًا.

كذلك يثير الذكاء الاصطناعي مخاوف اقتصادية، فقد أصبح تأثيره على الوظائف وديناميكيات القوى العاملة قضية محورية. فبينما يرى المؤيدون أن الذكاء الاصطناعي قادر على تعزيز الإنتاجية والابتكار، يخشى المنتقدون من فقدان الوظائف على نطاق واسع وعدم المساواة في المنافع.

المكونات الرئيسية للوائح الذكاء الاصطناعي

تتأرجح لوائح الذكاء الاصطناعي في العالم بين مدرستين: مدرسة تسعى إلى الابتكار المطلق مع أقل قدر من القيود، ومدرسة تتبنى “المبدأ الاحترازي” لحماية الخصوصية وحقوق الإنسان من مخاطر الانحياز والتحكم الآلي.

تركز اللوائح المختلفة التي تؤثر على تطوير الذكاء الاصطناعي واستخدامه على مجموعة الأهداف نفسها.

الخصوصية وحماية البيانات

وتعدّ الخصوصية وحماية البيانات عنصرين أساسيين في لوائح الذكاء الاصطناعي، إذ تُلزم تطبيقات الذكاء الاصطناعي بالامتثال للمعايير القانونية المتعلقة باستخدام البيانات الشخصية وتخزينها ومعالجتها. وتُسهم تدابير الخصوصية الفعّالة في بناء ثقة الجمهور بتقنيات الذكاء الاصطناعي من خلال حماية حقوق الأفراد في حماية بياناتهم.

كما يتطلب الامتثال للوائح الخصوصية من أنظمة الذكاء الاصطناعي دمج بروتوكولات أمن بيانات قوية وممارسات شفافة لإدارة البيانات. وتضمن هذه التدابير استخدام البيانات للأغراض المقصودة فقط، والحماية من الوصول غير المصرح به.

السلامة والأمن

أمّا عناصر السلامة والأمن في لوائح الذكاء الاصطناعي، فتتناول المخاطر المحتملة التي تشكلها تقنيات الذكاء الاصطناعي على الأفراد والمجتمع. وتضع هذه اللوائح معايير لضمان تشغيل تطبيقات الذكاء الاصطناعي بأمان، والحد من المخاطر كالأضرار غير المقصودة أو سوء الاستخدام الخبيث. كما تحمي التدابير الأمنية أنظمة الذكاء الاصطناعي من الثغرات الأمنية والتهديدات الإلكترونية التي قد تُعرّض سلامتها ووظائفها للخطر.

ويتضمن تطبيق معايير السلامة الالتزام بأفضل الممارسات في تصميم الأنظمة واختبارها ومراقبتها.

الشفافية وقابلية التفسير

كذلك تساعد الشفافية وقابلية التفسير في لوائح الذكاء الاصطناعي أصحاب المصلحة على فهم كيفية اتخاذ أنظمة الذكاء الاصطناعي للقرارات. تضمن هذه العناصر عدم غموض عمليات الذكاء الاصطناعي، مما يعزز الثقة بين المستخدمين وأصحاب المصلحة. ويسعى المنظمون إلى تطبيق تدابير تلزم أنظمة الذكاء الاصطناعي بالكشف عن وظائفها، مما يُمكّن المستخدمين من فهم مسارات اتخاذ القرار في النظام والبيانات المؤثرة في هذه القرارات.

وتشمل قابلية التفسير أيضًا تبسيط خوارزميات الذكاء الاصطناعي المعقدة لجعلها مفهومة. ومن خلال إزالة الغموض عن عمليات الذكاء الاصطناعي، يمكن لأصحاب المصلحة، بمن فيهم غير المتخصصين، اكتساب رؤى ثاقبة حول سلوك النظام.

المساءلة والمسؤولية

تؤكد لوائح الذكاء الاصطناعي على المساءلة وذلك لضمان خضوع مطوري أنظمة الذكاء الاصطناعي ومستخدميها للمسؤولية عن آثارها. كما تفرض على المؤسسات أن تتحمل مسؤولية أنظمة الذكاء الاصطناعي التي تنتجها، وأن تضع مبادئ توجيهية واضحة للمساءلة، وأن تُفعّل آليات لتقييم الأداء ومعالجة المشكلات، بما يضمن بقاء المطورين والشركات مسؤولين عن أفعال وقرارات أنظمة الذكاء الاصطناعي.

كما تمتد المسؤولية لتشمل الاستخدام الأمثل لتطبيقات الذكاء الاصطناعي، مما يتطلب من جميع الأطراف المعنية مواءمة نشر الذكاء الاصطناعي مع معايير السلامة.

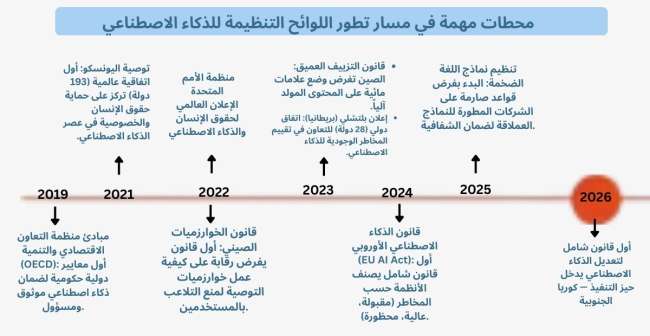

لوائح الذكاء الاصطناعي حول العالم

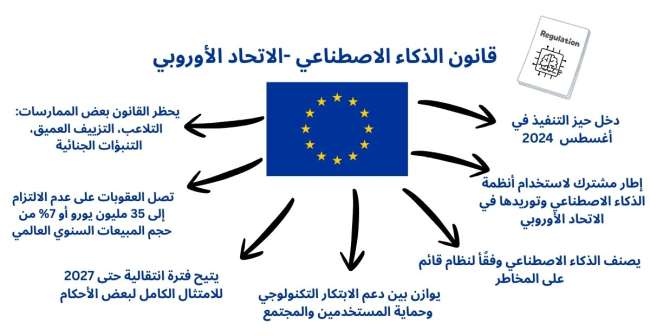

يُعد الاتحاد الأوروبي رائدًا بإصداره أول لائحة عالمية ملزمة وشاملة للذكاء الاصطناعي. اعتمد الاتحاد “قانون الذكاء الاصطناعي” في يونيو 2024، ودخل حيز التنفيذ في أغسطس 2024. يتبنى القانون نهجًا قائمًا على المخاطر؛ حيث يحظر الأنظمة ذات المخاطر “غير المقبولة” (مثل التلاعب بالسلوك أو المراقبة البيومترية الجماعية) ويفرض قيودًا صارمة على الأنظمة “عالية المخاطر”.

أمّا الولايات المتحدة، فلا تملك قانونًا اتحاديًا شاملًا واحدًا، بل تعتمد على مزيج من الأوامر التنفيذية والأطر الإرشادية.

ويُعتبر “قانون المبادرة الوطنية للذكاء الاصطناعي لعام 2020” القانون الأكثر شمولاً. وفي عام 2024 وحده، قدم المشرعون أكثر من 700 مشروع قانون متعلق بالذكاء الاصطناعي. وتبرز ولاية كاليفورنيا باعتماد أكثر من 25 قانونًا، تليها واشنطن بـ 6 قوانين، وكل من كولورادو ونيويورك بـ 5 قوانين.

أمّا الصين، فتتبنى رؤية تمنح الدولة دورًا مركزيًا للإشراف على تطوير ونشر الأنظمة بما يتوافق مع قيمها.

وهي تلزم الشركات بتصنيف المحتوى المولد آليًا ومنح المستخدمين حق رفض التوصيات الخوارزمية.

وتمتلك الصين أربعة تشريعات سارية، منها “التدابير المؤقتة بشأن جيل الذكاء الاصطناعي” التي أقرت في أغسطس/ آب 2023.

كذلك تعتبر كوريا الجنوبية من الدول السبّاقة في سن قوانين ملزمة وشاملة للذكاء الاصطناعي في منطقة آسيا والمحيط الهادئ.

فقد أُقر “ القانون الأساسي للذكاء الاصطناعي” في نهاية ديسمبر/ كانون الأول 2024، ومن المقرر دخوله حيز التنفيذ في يناير/ كانون الثاني 2026.

ومن جانبها، تعتمد بريطانيا حاليًا على مبادرات تهدف للموازنة بين إدارة المخاطر واستغلال الفرص الاقتصادية.

فقد أطلقت في عام 2024 “خطة عمل فرص الذكاء الاصطناعي (2024)” و”مشروع قانون أنظمة صنع القرار الخوارزمية والآلية للجهات العامة “.

المبادرات العربية في حوكمة الذكاء الاصطناعي

رغم غياب لوائح الذكاء الاصطناعي، تبرز المنطقة العربية، لاسيما دول الخليج، كمركز عالمي متسارع في صياغة سياسات التقنية، حيث تقود الإمارات العربية المتحدة هذا التوجه باستراتيجيتها الوطنية 2031 التي أطلقت منذ عام 2017، وقد عزّزتها في يونيو/ حزيران 2024 بإصدار “ميثاق الإمارات لتطوير واستخدام الذكاء الاصطناعي” الذي يوازن بين التقدم التكنولوجي والمسؤولية الأخلاقية، وصولاً إلى إعلانها في 2025 عن استخدام الذكاء الاصطناعي في صياغة التشريعات ذاتها.

وفي السياق نفسه، حققت المملكة العربية السعودية قفزات نوعية عبر الهيئة السعودية للبيانات والذكاء الاصطناعي “سدايا”، التي أصدرت في 2024 “وثيقة إطار تبني الذكاء الاصطناعي” وأطلقت أداة للتقييم الذاتي للأخلاقيات لضمان الامتثال للمعايير الوطنية.

وفي البحرين، جاءت “السياسة العامة لاستخدام الذكاء الاصطناعي” في مايو 2025 لتؤطر العمل التقني بما يتوافق م

رؤية 2030، بينما أصدرت سلطنة عُمان في عام 2025 سياستها الخاصة بالاستخدام الآمن والأخلاقي.

وفي دول المشرق، نجد الأردن يسير وفق خطة تنفيذية (2023-2027) امتداداً لسياسته الصادرة عام 2020، في حين قدم لبنان في يناير/ كانون الثاني 2025 “إرشادات حوكمة وأخلاقيات الذكاء الاصطناعي” عبر الجامعة اللبنانية كأول إطار توجيهي وطني شامل.

أما قطر، فقد تميزت بإصدار “دليل التبني والاستخدام الآمن للذكاء الاصطناعي” في 2024، لتكون أول تنظيم فعلي مخصص في مجلس التعاون، مكملة بذلك استراتيجيتها الوطنية التي بدأت في 2019.

وفي الجانب الآخر من الوطن العربي، تشكل مصر نموذجًا للتحول الحكومي والاقتصادي عبر “الاستراتيجية الوطنية للذكاء الاصطناعي 2025-2030″، التي تهدف لدمج التقنية في مفاصل الدولة، وبالرغم من عدم صدور قانون محدد حتى الآن، إلا أن المسودة الحالية للمبادئ الأخلاقية تركز بشكل صارم على الشفافية وحماية البيانات.

وفي المغرب العربي، يشهد المغرب حراكًا تشريعيًا بارزًا من خلال نقاشات البرلمان حول مشروع قانون لتنظيم الذكاء الاصطناعي يتضمن إنشاء وكالة وطنية للحوكمة، وذلك ضمن استراتيجية “المغرب الرقمي 2030” الرامية لتحديث الاقتصاد.

وفي تونس، تعمل “خارطة طريق الذكاء الاصطناعي 2021-2025” على بناء منظومة متكاملة تشمل البنية التحتية السحابية وتطوير المهارات ودعم الشركات الناشئة.

أما الجزائر، فقد وضعت استراتيجية وطنية للفترة (2024-2030) وعززتها بإنشاء “المجلس العلمي للذكاء الاصطناعي” في يونيو/حزيران 2023 كجهة استشارية للبحث والتدريب.

المنظمات الدولية ولوائح الذكاء الاصطناعي

ولا تقتصر جهود تنظيم الذكاء الاصطناعي على الدول. إذ تلعب العديد من المنظمات الدولية والإقليمية دورًا رئيسيًا في تطوير أطر تعاونية:

- مجلس أوروبا: وضع معايير لحقوق الإنسان وحوكمة الذكاء الاصطناعي.

- منظمة التجارة العالمية ومنظمة العمل الدولية: تحليل الآثار الاقتصادية والاجتماعية لتقنيات الذكاء الاصطناعي.

- الأمم المتحدة/ اليونسكو: تعزيز نهج أخلاقي وشامل.

- رابطة دول جنوب شرق آسيا: مبادرات لتعزيز التعاون الإقليمي في مجال الذكاء الاصطناعي.

- مجموعة البريكس: إنشاء آليات للتعاون التكنولوجي.

- مجموعة السبع/مجموعة العشرين: تنسيق السياسات بين القوى العالمية الكبرى.

- منظمة التعاون الاقتصادي والتنمية: وضع مبادئ توجيهية للذكاء الاصطناعي المسؤول.

لقد أثبتت الاستراتيجيات المتسارعة أن الحوكمة هي طوق النجاة الوحيد في عصر الذكاء الاصطناعي. إن التحدي الحقيقي الذي يواجهنا في السنوات القادمة لا يكمن في مدى قدرتنا على تطوير خوارزميات أكثر تعقيدًا، بل في قدرتنا على تطوير قوانين مرنة تسبق سرعة الآلة، وتضمن أن تبقى السيادة للبشر، وأن تظل هذه الأنظمة شفافة، ومسؤولة، وتحت السيطرة.

مقالات ذات صلة:

العنف الرقمي: كيف تحول الذكاء الاصطناعي إلى سلاح جديد ضد النساء

ثورة الذكاء الاصطناعي: الدليل الشامل لفهم التكنولوجيا التي تعيد صياغة العالم في عام 2026

اختبر معلوماتك حول حماية البيانات.. من سيربح 1,000,000؟

COMMENTS